Wie funktionieren automatische Antwortvorschläge im Messenger, und was lernen wir daraus?

Diverse Messenger (Telegram, WhatsApp, Teams …) bieten mir neuerdings automatisch generierte Vorschläge für Antworten auf Nachrichten an. Wird das dazu führen, dass ich Menschen in Zukunft fälschlich für Bots halte?

Automatische Antwortvorschläge im Messenger

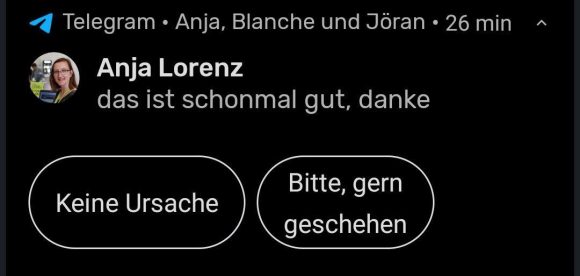

Wenn ich in diversen Messenger-Apps neue Nachrichten erhalte, bekomme ich neuerdings schon in der Vorschau Vorschläge für meine Antwort angeboten.

Das funktioniert ziemlich einfach: Der Algorithmus erkennt anhand eines Fragezeichens am Ende oder einfacher Schlüsselworte, welche Antworten sich anbieten würden. Zum Beispiel: Jemand schickt mir eine Antwort, die mit „Danke“ endet. Ich bekomme „Gerne geschehen“ oder „keine Ursache“ als Antwortoptionen zur Auswahl. Sobald ich eines davon anklicke, wird automatisch dieser Text als Antwort geschickt. Dabei – und das wird gleich wichtig – erkennt mein Gegenüber nicht, ob ich mir diese Nachricht ausgedacht und von Hand eingetippt habe, oder ob ich nur auf einen vorgegebenen Text gedrückt habe.

Im Browser kenne ich das schon länger, z.B. bei Glückwünschen auf LinkedIn. Auf dem Smartphone ist das jetzt eine qualitativer und quantitativer Sprung. Die Vorschläge sind i.d.R. passend und sehr bequem, gerade weil man sie über die Notifications direkt nutzen kann, ohne die App überhaupt zu öffnen. Außerdem halte ich es für plausibel, dass der Umfang möglicher Antwortsituationen zunimmt. Mittelfristig könnte die App zum Beispiel automatisch Terminvorschläge machen, wenn sie eine Anfrage erkennt (eine Verbindung mit meinem Kalender vorausgesetzt). Das könnte dann so aussehen:

Anja: „Wollen wir morgen dazu telefonieren?“

Jöran (automatische Vorschläge): „Gerne, passt es um 10.00 Uhr?“

Oder „Ja, wie wäre es um 14.30 Uhr? Da habe ich allerdings nur 30 Minuten Zeit.“

Oder: „Morgen geht es leider nicht. Wie wäre es am Freitag oder nächsten Dienstag?“

False Positive: Ich halte Menschen für Bots.

Wie wird sich das mittelfristig auf die Wahrnehmung von Kommunikation auswirken? Ich beobachte kurzfristig, dass ich Antworten von Menschen auf meine Nachrichten unter „Bot-Verdacht“ stelle.

Das kenne ich schon von Chats, die ich beispielsweise mit einem Support führe. Dort frage ich mich häufig, ob ich mit einem Menschen oder mit einem Algorithmus / einem Bot schreibe. (Ich frage übrigens meist direkt nach, das scheint als Test noch gut zu funktionieren.) Es gibt ja schon diverse Diskussionen darüber, dass wir Bots irrtümlich für Menschen halten würden. Bei mir stellt sich zunehmend die umgekehrte Frage: Ordne ich eine Kommunikation einem Bot zu, obwohl sie tatsächlich von einem Menschen kommt?

Meine Vermutung: Bis wir neue Gewohnheiten entwickelt haben, drohen uns viele „False Positive“-Ergebnisse in unseren täglichen, intuitiven Bot-Tests. Wir bekommen Nachrichten von Menschen und halten sie für Bots.

PS: Die Geschichte ist für mich ein guter Beleg, dass ein Turing-Test für „Künstliche Intelligenz“ nicht nur einen einfachen Dialog, sondern „mindestens 5 Minuten“ o.ä. Zusatzkriterien beinhalten muss.